L’Intelligence Artificielle est un domaine scientifique tentaculaire. Il est difficile d’appréhender globalement le sujet sans catégoriser.

Ce troisième et dernier article de la série a pour objectifs de proposer quelques perspectives potentielles et enfin de lister quelques nouvelles considérations liées à ce sujet.

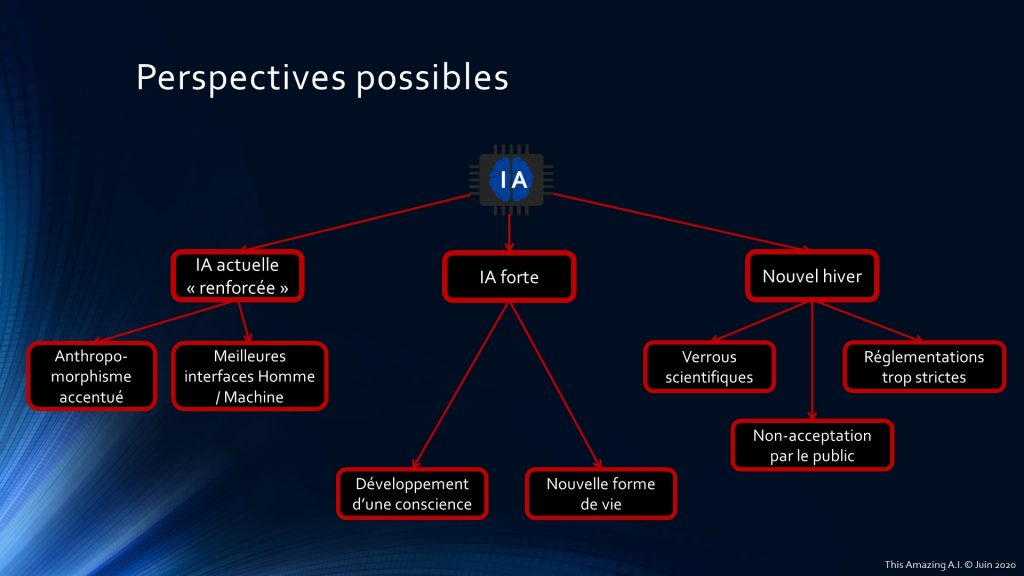

Perspectives possibles

Il n’est jamais facile de se lancer dans cet exercice. Nul ne peut deviner l’avenir même s’il peut y avoir des signaux faibles indiquant une direction plutôt qu’une autre.

Pour l’Intelligence Artificielle, nous pouvons tout de même raisonnablement envisager 3 scénarios :

- IA actuelle « renforcée » : nous allons suivre l’évolution « naturelle » des moyens technologiques et les besoins grandissant, le domaine va gagner en vigueur et les IA vont s’améliorer ;

- IA forte : nous allons assister à une véritable rupture scientifique et technologique pour voir apparaître la première IA consciente ;

- Nouvel hiver : dernier cas de figure, nous nous dirigeons vers une impasse pour des raisons que je vais détailler ci-dessous.

IA actuelle « renforcée »

Nous pourrions distinguer 2 axes : un anthropomorphisme accentué et de meilleures interfaces Homme / Machine.

Anthropomorphisme accentué

Au gré des recherches et des découvertes en neurosciences, nous affinerons toujours nos programmes artificiels pour les faire réagir (et traiter l’information) comme le ferait un être humain : amélioration de leur capacité d’observation, d’apprentissage, etc.

Par exemple, pour les algorithmes de réseaux de neurones et dans le cadre des recherches sur le processeur neuromorphique (conçu comme un cerveau humain avec des neurones et des synapses artificiels), des études récentes ont montré l’utilité d’incorporer une phase de « sommeil » dans un réseau de neurones à impulsion (SNN – Spike Neural Network) pour le stabiliser (Yijing Watkins et al.). Il est encore trop tôt pour savoir si ce procédé est généralisable ou à généraliser mais il semble donner de bons résultats dans ce cas précis.

Meilleures interfaces Homme / Machine

En effet, l’utilité première des programmes d’IA est d’exécuter des tâches répétitives, fastidieuses ou rébarbatives pour l’Homme d’une manière plus rapide et efficace. Il va de soi que nous avons besoin d’interagir avec les programmes que nous développons pour nous aider dans nos tâches. Il s’agit de vérifier leur bon fonctionnement, de contrôler leurs entrées / sorties et valider leurs résultats.

La technologie s’améliorant dans la reconnaissance vocale et la compréhension du langage (Natural Language Processing et Natural Language Understanding), nous voyons l’émergence de moyens de communication plus naturels que l’usage du clavier et de la souris. Nous avons certainement déjà tous fait l’expérience d’un Siri, Ok Google ou Alexa.

Peut-être que les futurs programmes d’IA ne seront plus pilotables qu’à la voix ou grâce à la détection des gestes, notamment pour le contrôle des robots. On parle d’ailleurs de cobots : robots collaboratifs « destinés à l’interaction directe du robot humain dans un espace partagé, ou là où les humains et les robots sont à proximité » (source Wikipedia).

IA forte

Autant il peut nous sembler normal que les technologies évoluent graduellement, autant il nous est plus difficile de concevoir un changement de paradigme (ou technologie disruptive dans le langage moderne). Dans le cadre de la création d’une IA forte, ce serait une révolution !

Développement d’une conscience

Et si nous arrivions à comprendre tous les fondements de l’esprit humain jusqu’à expliquer ce qu’est la conscience ? Et si nous avions la technologie nécessaire et l’envie de passer à l’acte ?

Certains philosophes dits fonctionnalistes (concevant l’esprit comme un système de traitement de l’information et comparant la pensée à un processus de calcul) estiment que les IA actuelles pourraient déjà être dotées d’une certaine forme de conscience.

Personnellement, je reste attacher à ce sentiment que la nature de notre conscience nous échappe encore pour le moment. Mais je ne détaillerais pas plus le sujet ici, je préfère l’aborder dans un prochain article.

Actons simplement que nous aurions réussi à doter une IA d’une conscience d’elle-même et des choses qui l’entourent.

Nouvelle forme de vie

Comme Victor Frankenstein avec sa créature, nous serions en présence d’une entité « vivante », pensante, capable de ressentir, communiquer.

Elle aurait des intentions et ses propres objectifs. Elle serait capable d’apprendre seule et d’apprendre à apprendre, développant ainsi sa capacité d’adaptation en imaginant de nouvelles solutions aux problèmes qu’elle rencontrerait.

Comme l’être humain, elle aurait certainement des besoins, des envies avec une forme particulière d’introspection. Développerait-elle également ses capacités émotionnelles et d’empathie ? Serait-elle capable d’aimer ?

Certes nous nageons en pleine science-fiction actuellement mais après tout, pourquoi pas ?

Nouvel hiver

Troisième scénario également très probable, nous n’arrivons plus à faire progresser ces programmes d’Intelligence Artificielle pour au moins 3 raisons possibles : des verrous scientifiques insurmontables, une non-acceptation partielle ou totale (rejet) par la population ou à cause de réglementations trop strictes. Un peu de tout à la fois ?

Verrous scientifiques

La discipline a déjà connu 2 hivers depuis sa naissance officielle en 1956. Il est tout à fait envisageable qu’une autre déconvenue survienne parce que nous arrivons au bout de notre capacité de compréhension des phénomènes physiques et mentaux (limite scientifique). Ou bien, nous n’arrivons pas à les retranscrire dans un programme ou une machine (limite technologique).

Deux futurs possibles : nous décidons d’arrêter définitivement la recherche en estimant que nous avons déjà atteint des résultats suffisamment satisfaisant pour nos besoins. Ou nous la mettons en sommeil dans l’attente de nouvelles découvertes scientifiques pouvant relancer les études et réalisations.

Non-acceptation partielle ou rejet

Nous pouvons percevoir dès aujourd’hui les effets et l’influence des programmes d’IA sur le grand public et dans l’inconscient collectif. Il y a des sentiments contradictoires de fascination, de méfiance voire déjà de rejet sur leurs capacités actuelles, futures, probables ou présumées.

Ce mois-ci, IBM et Amazon ont annoncé la fin de l’utilisation et de la commercialisation de systèmes de reconnaissance faciale. Il faut néanmoins nuancer ces informations car il s’agit d’une réaction à la situation actuelle aux Etats-Unis. D’ailleurs, la position d’Amazon n’est pas très claire. Ce ne serait qu’un moratoire d’un an.

Remarque : je ne parlerai pas de la Chine ni de l’usage des outils de reconnaissance faciale par le gouvernement chinois dans le cadre de son programme de « crédit social ».

Dans tous les cas, ces systèmes (ou plutôt l’utilisation que l’on en fait) portent évidemment déjà atteinte à notre vie privée. Et les données utilisées pour les entraîner peuvent comporter également des biais dangereux.

Si les programmes deviennent effectivement trop intrusifs, risquant de compromettre durablement et définitivement notre vie privée, il y a fort à parier qu’il y aura un phénomène massif de rejet.

Pour résumer, s’il n’y a pas de confiance voire de la défiance, il n’y aura peut-être pas d’avenir radieux pour l’IA. Les entreprises voudront sauvegarder leur image de marque et leurs profits ; et les politiciens, préserver la paix sociale.

Réglementations trop strictes

La conséquence directe des propos du paragraphe précédent serait la mise en application d’une réglementation stricte en la matière. Et je ne parle pas d’un contrôle exercé par la CNIL (Commission Nationale de l’Informatique et des Libertés) mais d’accords internationaux et autres moratoires pour limiter voire interdire certains types d’IA ou même l’IA tout court.

Faute d’un cadre légal adapté, le domaine scientifique n’aurait aucune chance de progresser et serait contraint à un nouvel hiver.

Nouvelles considérations

L’émergence de nouvelles formes d’Intelligence Artificielle, toujours plus efficaces, plus autonomes et de plus en plus en interaction avec les êtres humains, nous oblige à nous questionner.

Sur le plan moral et éthique, comment devons-nous considérer une IA « autonome » ? Si elle est douée d’une réflexion propre (avec peut-être une conscience), est-ce un être « vivant » à part entière ? Devrons-nous la laisser évoluer par elle-même (évolution darwinienne) ou la contrôler irrémédiablement ? Nos chemins se sépareront-ils temporairement ou à jamais ?

Remarque : je parle bien ici de notre éthique personnelle face à une IA autonome et non pas des questions éthiques liées au développement et à l’utilisation de programmes d’IA (en accord avec des principes humanistes, en évitant les biais, etc). Françoise Halper est bien plus compétente que moi sur ce sujet.

Sur le plan juridique, cette nouvelle « forme de vie » aurait-elle des droits ? Pourrait-elle se défendre ?

Sur les plans philosophiques, sociologiques et psychologiques, qu’en est-il de notre capacité de tolérance d’une IA de plus en plus proche de nous et toujours plus intrusive ? Finirions-nous par développer un complexe d’infériorité ? Voudrions-nous combattre cette IA, la réduire en esclavage ou au silence ?

Pour finir

Qu’en est-il de l’incarnation de l’intelligence artificielle comme un robot à visage humain par exemple ? Quelle serait notre position sur le plan individuel mais aussi collectif ? Serions-nous capable d’accepter « l’autre » comme une entité à part entière ? Pourrions-nous l’aimer ?

Nous choisirons peut-être une autre voie en hybridant des systèmes organiques et des systèmes artificiels pour créer des hommes augmentés, comme le souhaiterait Elon Musk avec Neuralink. L’avenir sera-t-il au transhumanisme ?

Je n’ai évidemment pas de réponses à toutes ces questions. Mais nous devons nous interroger sur ce que nous sommes, ce qui nous définit, ce que nous voulons car cela aura des conséquences sur nos vies.

Vous pouvez retrouver l’intégralité de cette présentation dans la section Infographies.